ChatGPTについて詳しく解説します

- ChatGPTの情報漏洩ってよく聞くけど実際どうなの?

- 社内でChatGPT使いたいけど、情報漏洩しないか不安

この記事では、以上の疑問にお答えします。

結論、ChatGPTの情報漏洩リスクはゼロとは言い切れません。

ただ、リスクを抑えて利用する方法も存在しています。

そこで本記事ではChatGPTにおいてなぜ情報漏洩リスクがあるのか、またその対処法なども合わせて解説していきます。

これからChatGPTを本格的に活用していきたいと思っている人はぜひ最後までご覧ください。

あわせて読みたい

目次

この記事のポイント!

- ChatGPTに入力した内容が漏れるリスクとしては大きく分けて2つ

- ①ChatGPTのアカウント情報そのものが漏れるリスク

- ②ChatGPTに入力した内容が学習に使われて漏れるリスク

著:I/O編集部

|

TipstourのChrome拡張記事を寄稿しました! 工学社さんより、ChatGPT×Chrome拡張機能を使ってより便利にChatGPTを活用する方法をまとめた書籍に、当ブログの記事が本書の1章に掲載されています。 |

入力した情報が漏洩する可能性

冒頭でも述べたようにChatGPTは情報漏洩のリスクが存在しています。

ChatGPTはユーザーから入力された文章が学習データとして蓄積される可能性があるため、社内情報を入力するのは非常に危険です。

入力情報を学習することについてはOpenAIの利用規約にも記載してあるので、気になる人はご覧ください。

仮に社内の情報が学習データとして利用されてしまった場合、他のユーザーが入力したプロンプト(入力文)内容によっては社内情報の一部が出力されてしまう可能性があります。

社内の機密情報だけであれば自社の損失だけに止まりますが、顧客データなどが流出してしまっては会社の信頼が損なわれてしまうでしょう。

ただ、入力データをChatGPTに学習させない方法も存在しています。これに関しては後ほど解説するのでそちらをご覧ください。

【事例】実際にサムスンはChatGPT利用で情報漏洩が発生した

ChatGPTから情報漏洩した直近の事例は「サムスン」です。

当初サムスンは社内でのChatGPTの利用を許可しており、社員はChatGPTを日常業務に活用していました。

ただ、ChatGPTに機密性の高い社内情報を入力した結果として少なくとも3件の情報が漏洩したとされています。

この件の影響で、サムスンは現在ChatGPTの利用を禁止しているとのことです。

サムスン電子は、従業員によるChatGPTなどの人工知能(AI)搭載チャットボットの使用を禁止した。米ブルームバーグ通信が報じた。こうしたAIサービスは、機密情報の流出につながることが懸念されており、職場での利用を制限する企業が相次いでいる。

ブルームバーグによると、先月あるエンジニアが社内機密のソースコードをChatGPTにアップロードし、誤って流出させたことが発覚。これを受けサムスンは先週、「生成AI」ツールの使用禁止を社内に通知した。

この情報流出がどれほど重大だったかは不明だが、サムスンは、AIチャットボットに共有されたデータがOpenAIやマイクロソフト、グーグルといったAIサービス運営企業のサーバーに保存され、容易にアクセスや削除ができない状態になることを懸念。さらに、ChatGPTなどと共有された機密データが最終的に他のユーザーに提供されてしまうことも懸念しているという。

ChatGPTはデフォルトでユーザーのチャット履歴を保存し、モデルを訓練するのに使用している。ChatGPTではユーザーが手動でチャット履歴の保存を無効にできるが、古いチャット履歴も削除されるかどうかは不明だ。

サムスンの他にもChatGPTを禁止している企業も多く存在しています。大手企業に関して言えば、例えば以下のような企業が挙げられます。

- アップル

- アマゾン

- ウォルマート

- ゴールドマン・サックス

ただ、逆に肯定的に利用している事例も存在しています。

例えば、東京都は2023年の8月からChatGPTを含む生成AIの導入を本格的に進めていくと報告しました。

他にも富山県や滋賀県などChatGPTを上手く活用しようとする流れも進んでいます。

確かに情報漏洩のリスクは存在しているものの、ChatGPTが便利なものである事実は変わりません。

しっかりとリスク対策を取った上で活用すれば、どの業界でも業務効率化を実現することが可能になるでしょう。

【リスク①】登録したアカウント情報が漏洩する可能性

ChatGPTは入力した情報が漏洩するだけではなく、個人情報が漏洩するリスクもあります。

これに関してはどのサービスでも可能性がゼロとは言えないため、一概にChatGPTだけが危険だとは判断できません。

しかし、現にChatGPTのアカウント情報の漏洩による、不正なログインなどの被害が発生していると報告されています。

例えば2023年3月にはChatGPT plusに加入している約1.2%の氏名やメールアドレス、住所やクレジットカード番号の下4桁が流出した可能性があると発表されました。

また同年6月にはダークWeb市場において「ChatGPTから漏洩した認証情報が10万件以上」取引されていることが分かりました。

これは、ChatGPTに入力した内容自体ではなく、ChatGPTへログインするためのアカウント情報が漏洩しているということです。

ChatGPT自体から情報漏洩したとか、ChatGPT自体に脆弱性というわけではないことに注意が必要です。

しかしながら、ChatGPTアカウントに不正にログインできるということは、入力した内容を自由に読むことが出来るということですので、それこそ重要な個人情報のオンパレードです。

ハッカーからしたら、宝の山と言っても過言ではないでしょう。

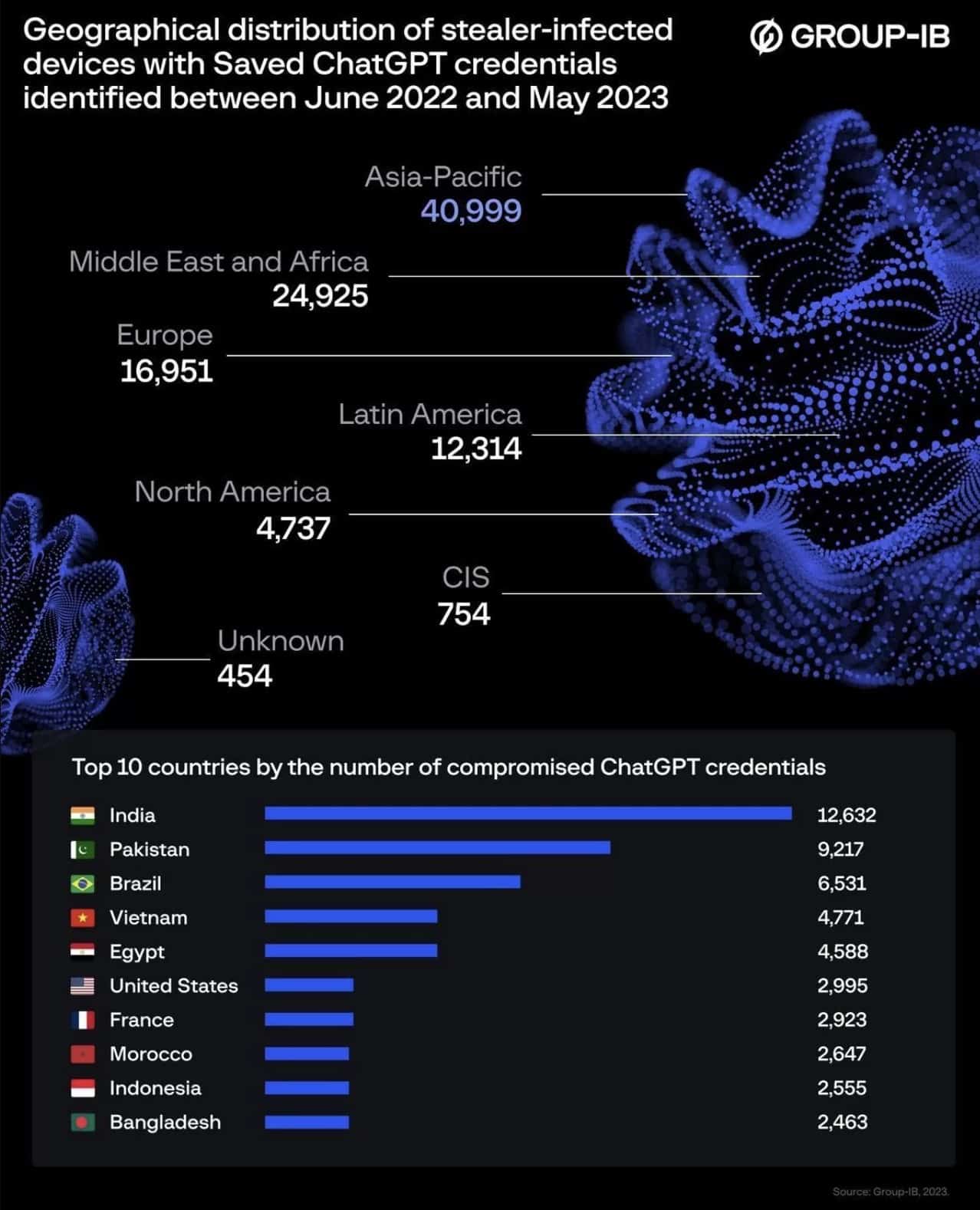

以下の図解は、ChatGPTのアカウント情報の漏洩が確認できたトップ10の国の一覧です。

幸い、日本はランクインしておらず、このアカウント情報が漏れてChatGPTを不正利用される事例は少ないようですが、用心することに越したことはありません。

アカウント情報の漏洩対策としては、月並みな方法ですがパスワードの変更が一番効果的です。

アカウント情報の漏洩は、アカウントのメールアドレスとパスワードの組み合わせが漏れてしまうことから発生するので、パスワードを定期的に変更することで、このリスクは大きく回避できます。

【リスク②】ChatGPTの情報漏洩リスクへの対策

ChatGPTに入力した情報・内容についても、やはり注意は必要です。

現時点で入力した内容が漏洩したという報告はありませんが、今後何らかの方法で漏洩する可能性もあります。

また、漏洩でなくとも、入力した内容をChatGPTのAIが学習して、他の人の回答に使われるリスクも捨てきれません。

入力情報の漏洩リスクを防ぐ方法としては、以下の2つが挙げられます。

- そもそも機密情報を入力しない

- 入力情報を学習させない設定にする

それぞれ解説していきます。

①そもそも機密情報を入力しない

シンプルかつ現時点で最も有効な方法は「そもそも漏洩したらダメな情報は入力しない」です。

当たり前ですが、機密情報を入力しなければ漏洩する可能性はありません。

社内教育が行き届くのであれば、ChatGPTを全面的に禁止するのではなく「社内の機密情報や顧客データの入力のみを禁止する」といった方法も1つの手だと思います。

ただ、どこまでの入力を許可するのかは曖昧な部分も多いでしょう。

もし社内でChatGPTを活用する場合にはマニュアルなどをしっかりと作成した上で、社員の誤解が生まれないように注意してください。

リリース時期や詳細は未定ですが、これが提供されれば、機密情報の入力リスクなどを気にせず、ChatGPTの機能を利用できるようになると思われます。

②入力情報を学習させない設定にする

ChatGPTには「入力情報をChatGPTに学習させない設定」が存在しています。

こちらを利用することで、ChatGPTに入力内容を保存・学習させないようにすることも可能です。

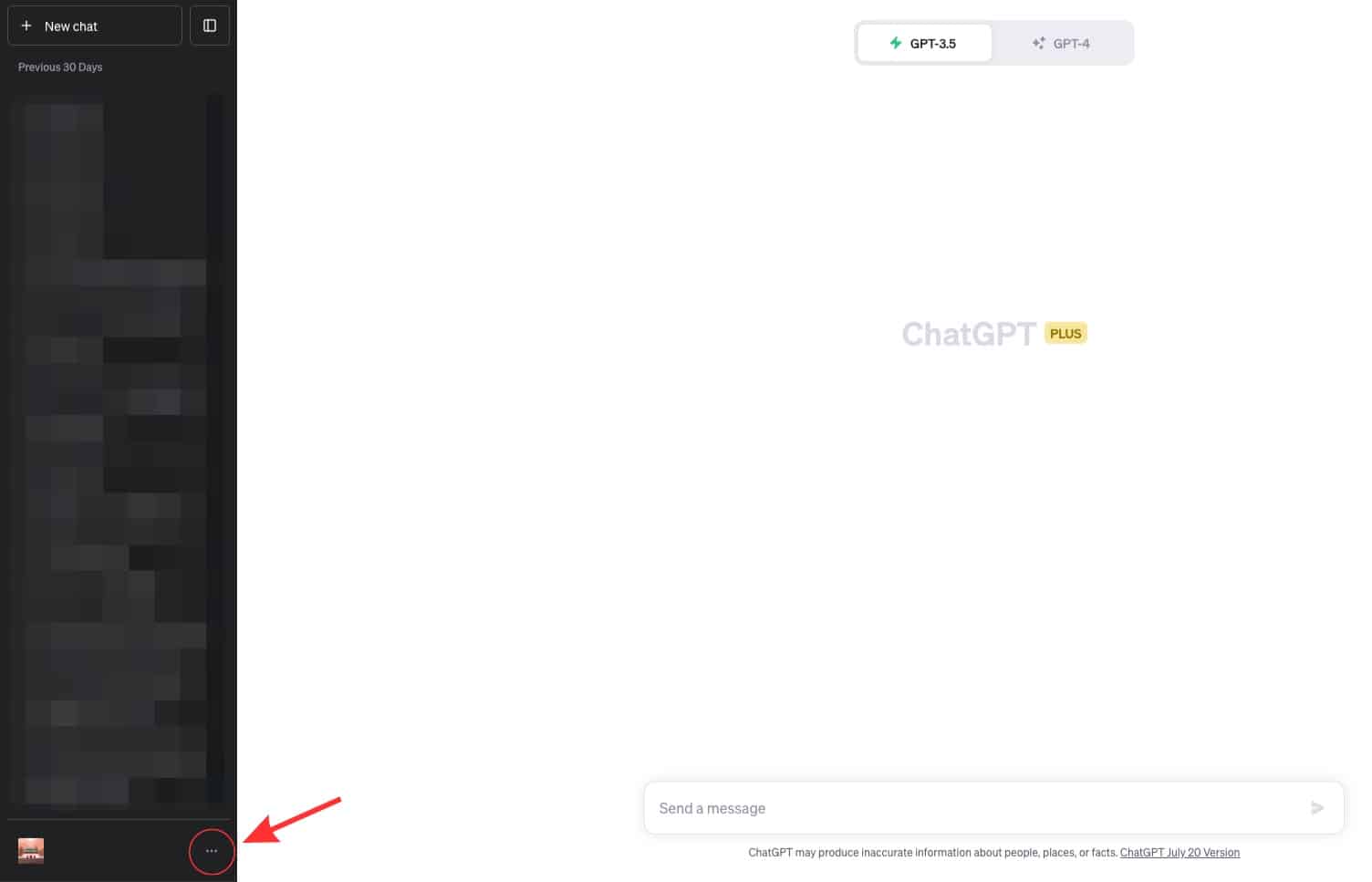

まずはホーム画面から右下の「…」を押してください。

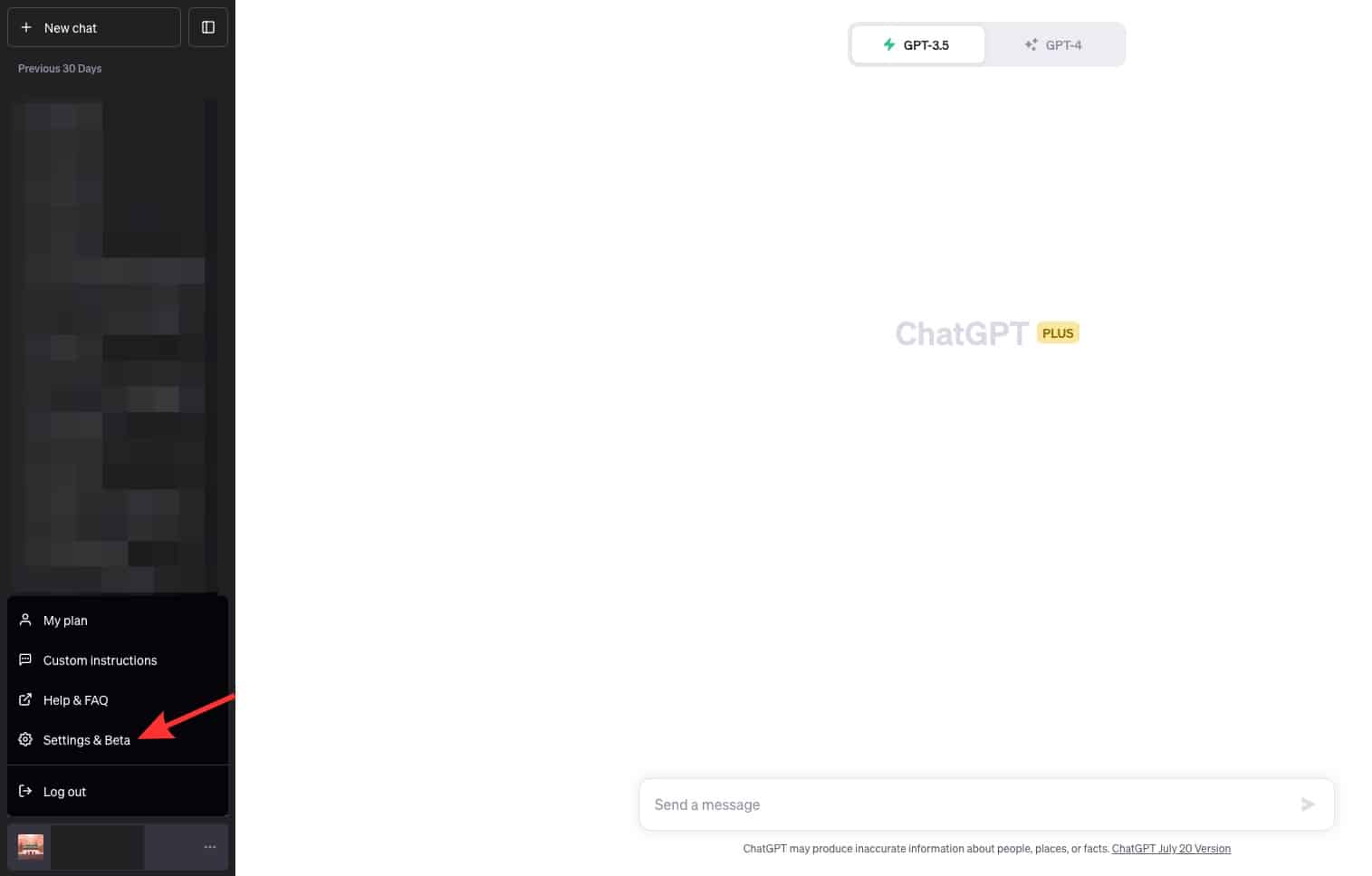

続いて、「Setting & Beta」をクリックします。

「Data controls」の「Chat history & training」をオフにしてください。

この設定をすれば入力情報がChatGPTに学習されないようになるため、他のユーザーの出力内容に社内の機密情報が漏洩する可能性はなくなります。

ただ、これをすれば情報漏洩が完全に防げるわけではありません。

これに関しては後ほど詳しく解説するため、必ずご覧ください。

また、この設定をオフにすることによってトーク履歴(ブラウザ版の左側に羅列してある部分)が残らなくなります。

過去のトーク履歴を後で使うことがある人も多いと思うので、オフにすることによって利便性が下がる人も少なくないでしょう。

入力情報を学習させない設定の注意点

「Data controls」の「Chat history & training」をオフにすることによって、確かに入力情報を学習させないようにすることは可能です。

ただ「この設定をする = 情報漏洩しない」とは言えません。

この設定をオフにしたとしても、ChatGPTのトーク内容は30日間はOpenAIのサーバーに保存されます。

つまりOpenAIのサーバーがサイバー攻撃された場合は、そこから情報が漏洩する可能性もあるわけです。

ここに関してはインターネット上でも誤解している人が多いため、正しい情報を理解しておきましょう。

この仕組みについては、以下の記事でも詳しく解説していますので、あわせてご覧ください。

まとめ

以上、ChatGPTに情報漏洩のリスクはあるかどうか、事例や対策などのまとめでした。

この記事のポイント!

- ChatGPTに入力した内容が漏れるリスクとしては大きく分けて2つ

- ①ChatGPTのアカウント情報そのものが漏れるリスク

- ②ChatGPTに入力した内容が学習に使われて漏れるリスク

記事内で解説しているようにChatGPTは情報漏洩のリスクはゼロではありません。

ただ、これに関してはどのサービスでも言える点でもあるため「ChatGPTだけが危険性の高いサービス」とは言えないでしょう。

「情報漏洩リスクがあるからChatGPTは全面的に禁止」と早急に判断するのは、個人的には勿体無いと思ってしまいます。

ChatGPTを上手く活用すれば、これまでの業務を圧倒的に効率化できる可能性も十分に考えられるわけです。

最初から取り入れる選択肢を無くすのではなく、まずは正しい知識を理解した上で検討するのをおすすめします。

もちろん情報漏洩のリスクは考えるべきですが、個人的にはリスク対策を取った上で活用できそうな場面から少しずつでも取り入れてみるべきだと考えます。

また、皆さんがフリーランスや企業のご担当者さんで、ChatGPTを業務に利用するかどうか検討している場合、こちらの書籍も役立ちます。

あわせてどうぞ。

以上、ご参考までに!

それでは!